作为一个人工智能主题的公号,已经好久没碰AI这个话题了,说起来有点不像话。最近这几年AI的进展实在太快,各种热点话题虽然很多,但是热点来的快,去的也快,本号期望写出来的东西能经得起时间考验,所以一直没有动笔。。。好吧,以上是借口,主要还是。。。人艰不拆,这次就来写一写AI, 没有什么主题,想到哪里就写哪里。所以叫做杂谈。

还是先从前一段时间最火的龙虾说起, openclaw算是最新一个AI应用的破圈产品,特别是春节后,达到了热点的峰值,所有AI相关的大厂都推了自己的方案,似乎不养一只龙虾就跟不上时代了。自媒体上也充斥各种流行梗。 比如龙虾取代人了的工作,某天上班,发现隔壁座位空无一人,只有一个同事Skill;多养几只龙虾,用各种大厂pua话术pua龙虾云云。 然而几个月后,潮水退去,还剩下几个人在折腾龙虾?后续的改进产品爱马仕也没掀起多大波浪。

以我自己的经历,也花了很多时间折腾龙虾。回顾总结一下,其实大部分时间都是在解决龙虾自己的配置问题。为了能实现一些自动化的功能,需要配置各种API, 龙虾基本上每过2天就发一个版本,早期每次升级都会带来一些问题,大的功能升级,比如执行命令的安全性限制,还会让之前的配置全部作废。因此可能有超过八成的时间都在修龙虾,剩下一点时间基本都是在尝试各种skill。几个月后,龙虾还能有点用处的功能就剩下每天发几个新闻简报了。

这跟当初的预期似乎相差很远。但其实这也是技术发展的规律,热点过后,沉淀下来的才会是真正有价值的应用。推动龙虾这类产品破圈背后实际上是技术的进步,大约在半年前,AI编程能力的持续改进突破了可用的临界点,全面超越了初级码农的水平。能体验到这个质的变化的一开始只有日常搞编程的码农。而龙虾借助编程能力的突破,可以通过写脚本来完成日常任务,把这种能力展现给了公众,才让大家意识到AI原来这么强了,产生了一时的破圈效应。

在编程之外,AI还远不是无所不能,只是在个别应用领域,比如绘图,视频生成超越了人。但是AI在每一个应用领域的突破,都会全面改造这个领域的工作形式和流程,当然也会影响这个领域的工作机会。那么问题来了,下一个突破是什么?或者回到更根本的问题, 通用的AI能力,全能的六边形战士, AGI 什么时候来?

回答这个问题相当困难,甚至AGI本身是什么都缺乏普遍认可的定义。当下的进展也仍然是在探索阶段,还存在的极大的不确定性。但我们还是可以借助引领AI进展的聪明人的观点,比如可能当世最懂AI的几个人之一,Deepmind的哈萨比斯的观点,来一窥究竟。

哈萨比斯不仅是世上少有的聪明人,更是非常罕见的,愿意跟人分享,并且能够把自己的想法解释的浅显易懂的聪明人。想了解AI进展的大方向,最近几年哈萨比斯的讲话和一些技术博客的访谈都非常值得精读。哈萨比斯属于技术乐观派,他认为各种问题都可以也应当靠技术的发展来解决,并且他本人预期AGI回来大约5年之后,2030年左右真正到来。

本文不想简单重复哈萨比斯的观点,感兴趣的还是建议去阅读原文。还是回到AI的基本框架,特别是最近几年大语言模型的突破本身,来探讨一下AI的可能进展方向。

可能很多读者已经了解过,最近几年大语言模型的突破,是依赖于一个简单的范式, 就是预测语言里的下一个词。通过这样一个简单的范式,通过学习海量的数据,可能包括当前互联网上所有的文本知识。 大模型学会了理解语言内在的结构,也掌握了用语言表达的知识。 可能有人会说,大模型内部像一个很像,我们并不知道模型是不是真正理解了知识。 这种说法很难反驳,因为理解本身就是一个很难精确定义的概念。只从输入输出的角度,只要对于我们给的问题, 模型能像真正理解这个问题并且掌握知识的人给出同样水平的输出,我们就假定,模型也同样“理解”了这些知识。

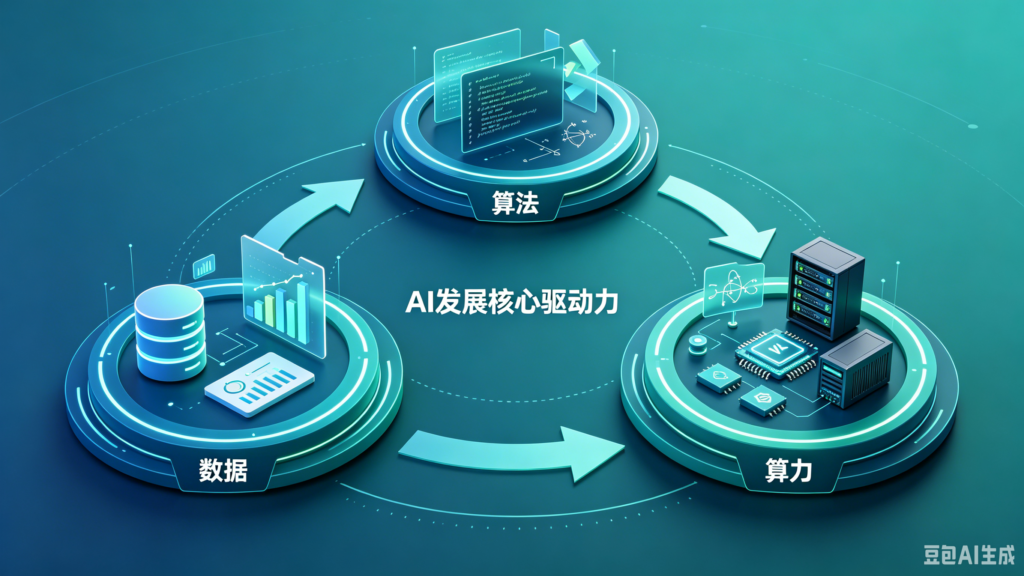

按照这个范式,一个大模型要具有和人一样的能力, 我们需要准备覆盖领域知识的充足的数据, 设计能够表示学习这些知识的算法,还需要有提供充足计算能力的硬件设备。这也就是影响AI下一步可能进展的三个关键因素:数据,算法,算力。

先从数据说起,大语言模型能够成功的前提条件之一,就是人类已经积累的文本知识,随着互联网的发展,人类已经把所有的书籍,各种知识积累都数字化了,这就方便了大模型的取用。大模型实际上是借助了人类的语言,这种对现实世界的符号化表示,来学习,掌握和理解现实世界。有观点认为,人脑的学习不光是通过读书写字掌握的语言知识,还有直接来源于感官的关于现实世界的输入部分。这是当前大语言模型缺失的环节,理解描述现实物理世界的世界模型。 因为没有世界模型, 虽然在数字世界里,大模型已经达到了人类智能,但是回到现实,机器人面对物理世界还是表现的十分蠢笨。 能否在物理世界建立一个类似于预测下一个单词的范式,来让模型预测学习物理世界,是机器人是否能突破的关键,也是机器人研究的前沿方向。这里就不进一步展开了。

从GPT-3 突破到现在已经过去的3年多,模型的规模越来越大,能力越来越强,所需要的训练数据也越来越多。一种看法是,当机器学习已经用尽了我们之前积累的所有数字化知识,就会触及到模型的能力的边界。因为没有足够的数据,喂不饱模型,模型就不会变的更“聪明”。本文不同意这种观点, 因为除了利用已有的数据,其实还可以“生成”更多的数据,当下制约AGI主要环节是其实是如何有效表示和产生物理数据。

另外有一类特殊场景,比如游戏,在人工控制的环境下,实际上可以生成无穷无尽的数据。这也是为什么AI最先是在棋类领域突破。 下棋的数据可以要多少有多少,而且因为下棋有简单的规则判断输赢,我们可以利用结果来给数据做好坏的标记,就可以利用强化学习算法来提升模型的性能。为什么去年大模型能在编程任务上突破,也是这个原因,跟游戏类似,编程也是一个很适合AI学习的控制环境,有明确的任务目标和简单判断成败的方法,可以充分利用生成数据和强化学习来提升模型的性能。

有了数据,更重要的是模型和算法,如何让模型能充分利用数据,建立对数据的理解能力并不是一个简单的问题,从深度学习,到残差网络,到Transformer, 通过模型算法的一次改进,现代的模型具有更复杂的结构,更大的规模,更多的参数,也能学习理解更多的数据。 这就是著名的规模定律, 一句话表达,越大的模型越聪明。

回到哈萨比斯的观点,他实际上一直在思考一个更深层次的问题, 为什么模型的学习算法会如此有效? 现实世界实际上极端复杂,甚至人造世界,比如围棋的可能局面都超过宇宙中包含所有原子的数目很多个数量级,AlphaGo竟然可以充分理解掌握规则,并且下出超出人类理解能力的惊天一手,这本身就是一件值得思考的问题。 哈萨比斯的看法是, 虽然这些问题看上去复杂,因为指数爆炸原因,无法通过暴力破解。 但都存在某种可以内在简化的结构,用数学语言来说,就是高维问题空间的可行解构成一个可以映射到低维的流形。 学习算法就是找到这个低维流形,然后就可以在低维流形中,通过梯度优化来找到可行或者最优的解。不理解这段数学语言也没关系。总之就是其实世界没有看起来那么复杂,里面有隐藏的结构,我们的大脑也好,AI也好,都有能力发现这种隐藏的结构,所以才能学习理解世界。

AlphaGo之后让哈萨比斯获得诺贝尔奖的的AlphaFold也是在现实世界中找到了类似的“甜点”。蛋白质折叠这个问题本身比围棋更复杂,也就是说问题的解空间比围棋还大很多数量级。但是alphafold通过对有限数据的学习,竟然也理解掌握蛋白质折叠的方式,可以让很多通过一个一个实验来解析单个蛋白质结构的研究人员,从繁忙劳累的重复工作中解脱出来,思考更有意义的问题,也是基于同样的理由。 哈萨比斯还猜想,自然界长期演化的各种物理现象,大到宇宙,星系,恒星,行星的运动方式,小到细胞生命,甚至复杂到人脑和意识,都存在着类似的内在结构,可以通过算法学习和理解。

多说几句,所谓的通过算法学习和理解究竟是什么。从信息的角度来看,就是在做压缩,是发现对物理世界更为有效的表达方式。不管是人类的语言,还是数学,本质上都是在做压缩。通过发现物理世界中包含的内在结构,就可以通过建立符号系统,符号之间的结构关系和演化规则,来压缩表示物理世界,并且预测物理世界下一步的演化方向。

在AlphaFold之后,哈萨比斯还提到他们做了通过神经网络学习预测天气的系统。描述大气运动的物理方程,因为非线性,并且存在着破坏数学结构的很多奇点,无法通过解析方程来计算,传统的天气预报方法是利用网格计算,把大气拆分成物理网格,在每个节点做简化近似计算,网格拆分的越细,计算的精度和准确性就越好,当然所需要的计算规模就越大。这是传统的暴力方法,也是没有发现物理现象可能存在的内在结构前提下,唯一的可行办法。然而通过神经网络学习,可以破解这一疑难,同样的精度下,利用更少的算力,能达到一样预测结果,也就达到了对物理世界更强的“压缩”。

数据算法之后,再谈谈算力。 没有充分的计算能力支持,再好的算法和模型也只是空谈。其实神经网络的算法和模型已经出现了50多年了,困于计算能力的制约,一直展现不出能力和效果。这个方向在上世纪80年代短暂热闹了一阵后就归于沉寂,只有少数几个人坚守,直到计算能力的突破,并行GPU计算的出现,才迎来了真正的春天。

实际上,早期计算能力一直有所谓摩尔定律,通过制造工艺的改进,把计算单元晶体管做的越来越小,单位面积下晶体管越来越多,计算能力可以通过提升计算频率,增加计算并行度两个方向来同时提升。在当下,晶体管制造工艺已经越来越逼近物理极限,单纯计算频率的提升已经触碰到功率墙等物理极限,很难再有大的进展。 能够增加算力的主要方向是提升并行度,通过增大芯片的规模,集成越来越多的计算单元。正好神经网络计算本质上是高度并行化的,可以充分适应当下的硬件发展方向。最近这些年,通过增加计算单元的并行度,GPU计算能力的增加速度甚至比当年的摩尔定律更快。

另一方面,计算能力的提升还有很多制约因素, 制造工艺的物理极限是一个, 如何设计有效的架构,匹配计算和存储单元也是一个,还有功耗的制约,大规模的并行计算单元消耗大量的能源,要考虑能源成本,散热效率等一系列物理环境问题。也许能源的终极解决方案需要永远再等50年的可控核聚变。

最后再简单说说AI未来可能的落地方向。首先是世界模型的突破和机器人真正的应用爆发,这可能是1-2年内就发生的事。同时也会创造一个巨大的新市场。其次是AI在端侧的落地,不管是绑定AI的手机,还是AI眼镜等新设备,都需要围绕AI,重新定制交互范式。当下的AI agent甚至退回到命令行界面,这只是权宜之计,并不是很好的解决方案。最后是AI在商业场景下的落地,从取代码农开始,通过一步步的同事.skill, 提升商业环境的自动化效率。 这可能是一个长期缓慢的过程,主要障碍不是技术成熟度,而是商业模式和组织文化的适应和调整。

当然还有大家可能最关心的问题,AGI到来之后,我们怎么办?是不是大部分人都没事做了,人生的意义何在。 本文不能给出答案,但作者赞同哈比萨斯的技术乐观主义,技术发展带来的问题还是要通过技术发展来解决,也许未来会有更多提前预想不到的机会呢?